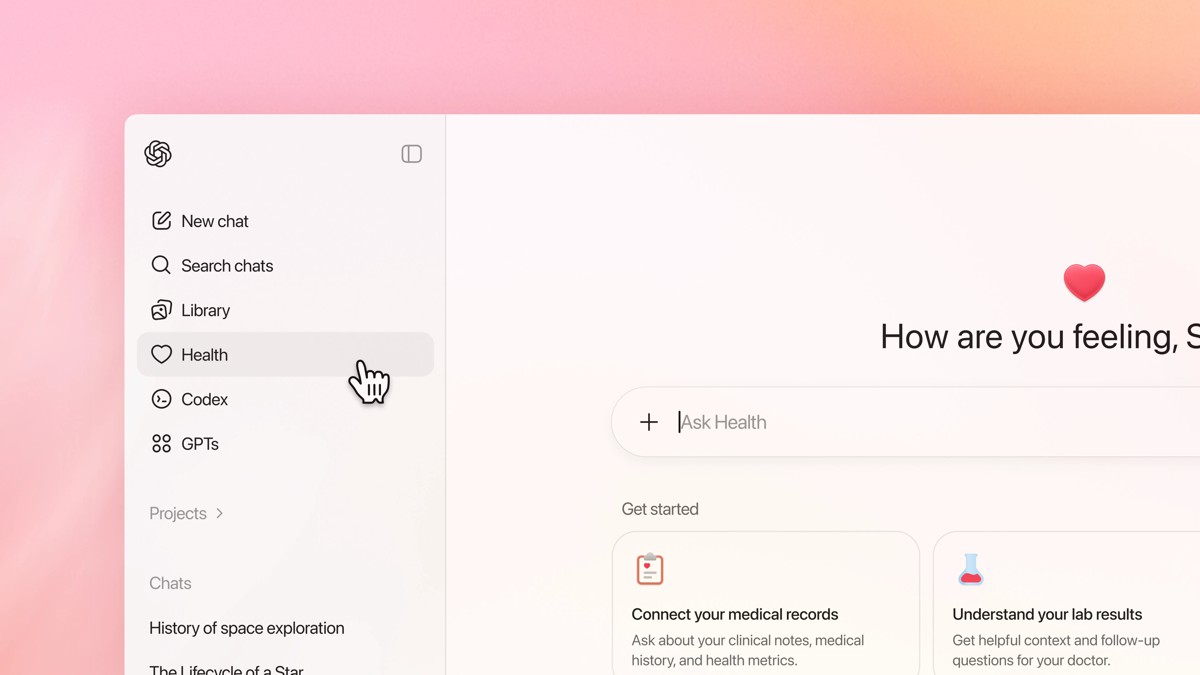

隨著 2026 年初醫療 AI 戰火升級,ChatGPT Health 的問世引發了醫學界的激烈討論。根據最新數據,每週有超過 2.3 億 人向 ChatGPT 諮詢健康問題,這讓 OpenAI 決定將其正式化。然而,第一線醫生卻對此抱持謹慎態度。 TechCrunch 報導有位外科醫生 Sina Bari 告訴他們,曾遇到病患拿著 ChatGPT 的對話紀錄,聲稱開給他的某藥物有 45% 的機率導致肺栓塞——事後證明,那只是針對結核病特定子群體的極端數據。這反映出 AI 在處理高度專業數據時,仍存在嚴重的「去脈絡化」風險。

隱私紅線與「幻覺」警訊:GPT-5 的醫療大考驗

這點令人意外:根據 Vectara 的事實一致性評估模型(Factual Consistency Evaluation Model),OpenAI 的 GPT-5 在數據精準度上,竟然比 Google 或 Anthropic 的模型更容易產生「幻覺」。這在分秒必爭的醫療決策中,無疑是一枚定時炸彈。

此外,隱私監管也是一大挑戰。ChatGPT Health 允許用戶同步 Apple Health 與 MyFitnessPal 的數據,這意味著高度敏感的醫療資訊正從符合 HIPAA(美國醫療保險隱私法案)的機構,流向尚未完全受規管的技術供應商。資料外洩防護公司 MIND 的創辦人 Itai Schwartz 便直言,監管機構將如何介入此一領域,將是接下來的觀察重點。

醫療 AI 競爭格局與技術痛點

| 產品名稱 | 核心定位 | 主要數據源 | 關鍵挑戰 |

| ChatGPT Health | 患者端的個人健康助手 | Apple Health, MyFitnessPal | GPT-5 的幻覺風險、監管合規性 |

| Claude for Healthcare | 提供者與保險方的行政工具 | PubMed, ICD-10, CMS 數據庫 | 專業知識的精確對接 |

| ChatEHR (Stanford) | 臨床醫生的電子病歷助手 | EHR (電子健康紀錄) 系統 | 醫療院所內部的系統整合 |

醫生真正想要的是「行政代理人」而非「聊天機器人」

儘管對患者端 AI 感到憂慮,但史丹佛大學的 Nigam Shah 教授提出了另一個視角:目前美國門診預約動輒要等 3 到 6 個月,在「等半年看醫生」與「現在問 AI」之間,多數病患別無選擇。

因此,醫界更看好 AI 在「供應商端」的應用。Anthropic 的產品長 Mike Krieger 指出,醫生每天花費近一半的時間在處理行政文書。如果透過 Claude for Healthcare 自動化處理「事前授權」(Prior Authorization)案件,每案可節省 20 到 30 分鐘。同樣地,史丹佛開發的 ChatEHR 讓醫生能快速檢索病歷,不必在數千頁的紀錄中「翻找」。

評論:技術野心與醫療倫理的拉鋸

我們認為,ChatGPT Health 雖然解決了部分就醫門檻問題,但醫療的核心始終是「保護病患」。正如 Bari 醫生所言,醫生必須保持「犬儒且保守」的態度,因為技術公司的首要考量是股東利益,而醫生的首要考量是人命。AI 若能成為醫生的「行政分身」,釋放醫生與病患對話的時間,那才是醫療 AI 真正的靈魂所在。